GPT-4-Base:不依赖微调,大模型能多听话?

探索GPT-4-Base的潜力,瑞士EPFL团队试图在不依赖微调的情况下,通过上下文学习让大语言模型变得更听话。尽管取得了一些进展,但完全缩小上下文学习和指令微调之间的差距仍然具有挑战性。 GPT-4-Base:不依赖微调...

探索GPT-4-Base的潜力,瑞士EPFL团队试图在不依赖微调的情况下,通过上下文学习让大语言模型变得更听话。尽管取得了一些进展,但完全缩小上下文学习和指令微调之间的差距仍然具有挑战性。 GPT-4-Base:不依赖微调...

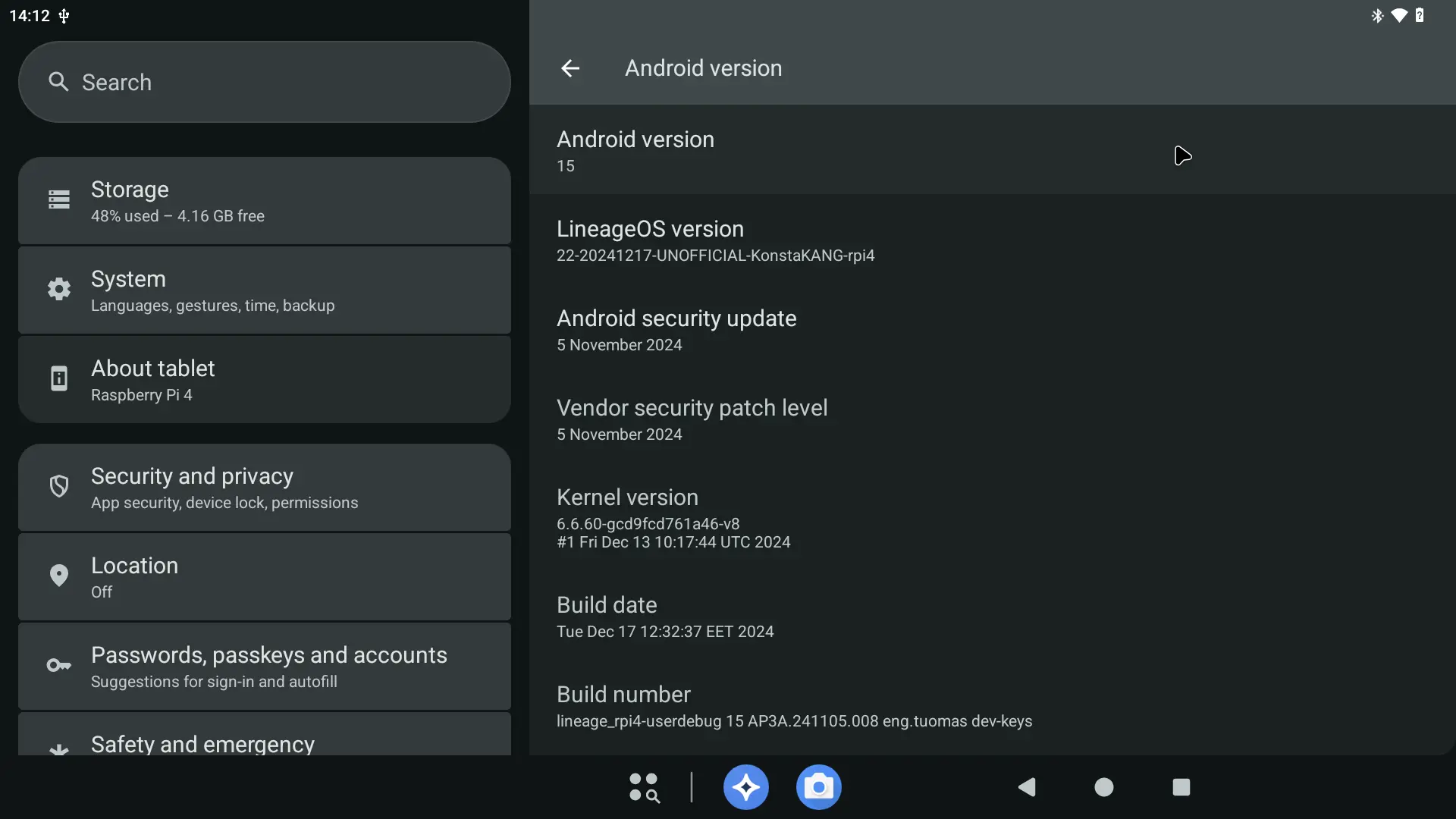

| 硬件设备 | 规格要求 | 备注 |

|---|---|---|

| 树莓派4 | 至少2GB RAM版本 | 4GB或8GB版本体验更佳 |

| MicroSD卡 | 至少16GB,建议32GB | Class 10或更高速度等级 |

| 电源适配器 | 5V 3A Type-C | 功率不足会导致各种奇葩问题 |

| HDMI线缆 | Micro HDMI to HDMI | 树莓派4用的是Micro HDMI接口 |

| 显示器/电视 | 支持HDMI输入 | 1920x1080分辨率最佳 |

| USB键盘 | 任意品牌 | 安装过程中必需 |

| USB鼠标 | 任意品牌 | 触控操作必备 |

| 读卡器 | USB接口 | 用于烧录镜像 |

重要提醒:树莓派4对电源要求比较严格,千万别用那种杂牌充电器,不然系统跑起来比蜗牛还慢 🐌

https://konstakang.com/devices/rpi4/https://konstakang.com/devices/rpi5/lineage-21.0-20240816-UNOFFICIAL-KonstaKANG-rpi4.zip

小贴士:文件大小通常在1-2GB左右,建议用迅雷或者其他下载工具,避免浏览器下载到一半断网 😅

NikGapps-core-arm64-14-20240315-signed.zip

注意事项:烧录过程中SD卡会被格式化,确保里面没有重要数据。如果有,记得先备份。

adb reboot recoveryresolution.txt文件1920x1080// 示例:自动签到脚本

function autoCheckIn() {

// 模拟点击签到按钮

click(500, 800);

// 等待3秒

sleep(3000);

// 返回桌面

keycode("HOME");

}

| 应用名称 | 功能特点 | 适用场景 |

|---|---|---|

| Kodi | 全功能媒体中心 | 本地视频播放 |

| Plex | 在线媒体服务器 | 远程串流播放 |

| VLC | 万能播放器 | 各种格式支持 |

| 测试项目 | 树莓派4 (4GB) | 入门级安卓手机 | 中端安卓平板 |

|---|---|---|---|

| CPU性能 | 85,000 | 120,000 | 180,000 |

| GPU性能 | 25,000 | 45,000 | 80,000 |

| 内存性能 | 40,000 | 35,000 | 50,000 |

| 存储性能 | 15,000 | 25,000 | 35,000 |

小贴士:由于硬件限制,建议选择720p或1080p画质,避免4K视频卡顿 🎬

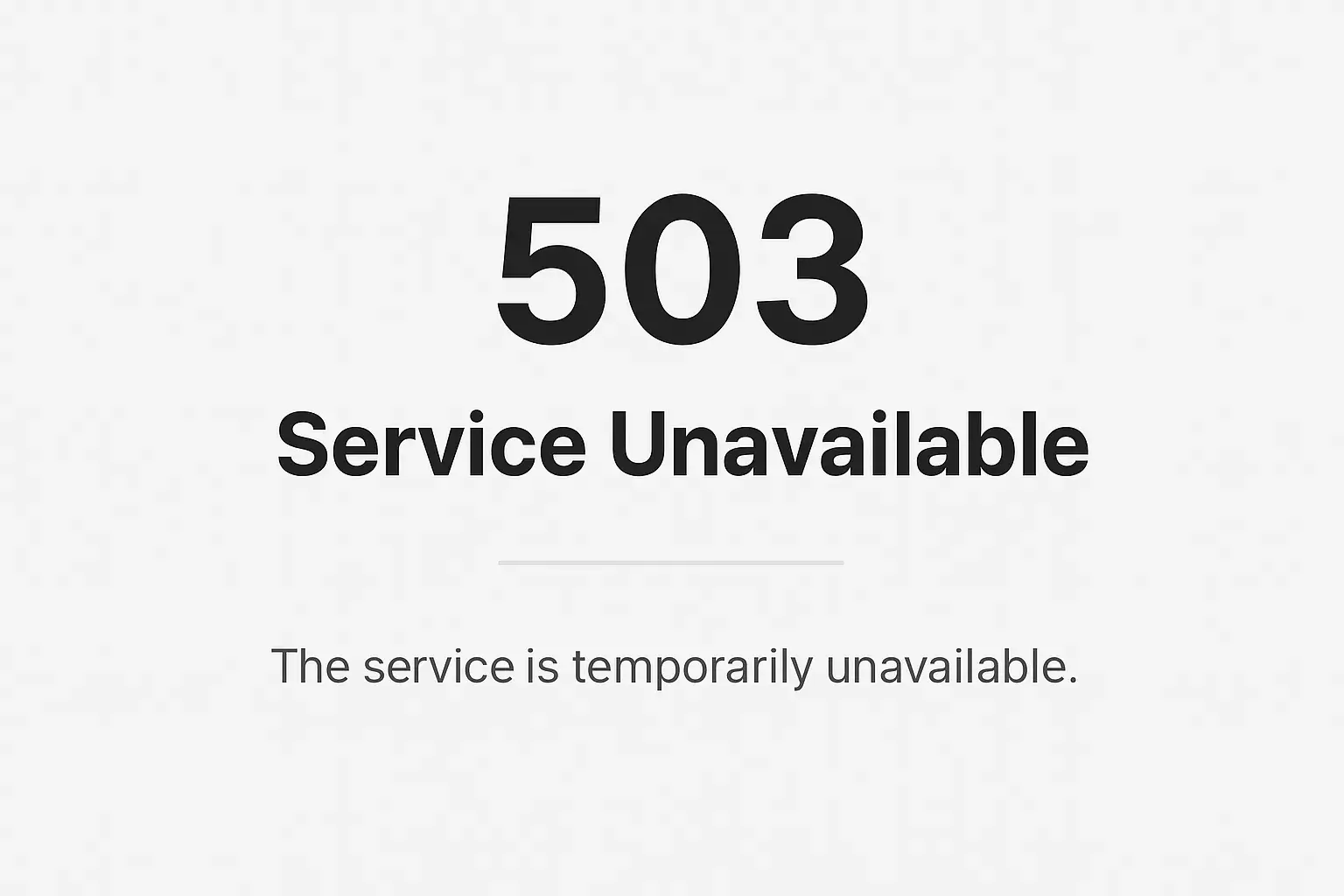

https://konstakang.com/https://forums.raspberrypi.com/https://lineageos.org/ 503错误,这个看起来很技术范儿的名词,其实就是服务器的一种"我太忙了,处理不过来"的委婉表达。它不像404那样直接告诉你"页面找不到了",也不像500那样暗示"我内部出了点问题",而是很礼貌地说:"不好意思,我现在真的很忙,你能等等吗?"

503错误,这个看起来很技术范儿的名词,其实就是服务器的一种"我太忙了,处理不过来"的委婉表达。它不像404那样直接告诉你"页面找不到了",也不像500那样暗示"我内部出了点问题",而是很礼貌地说:"不好意思,我现在真的很忙,你能等等吗?"

在互联网的世界里,503错误就像是餐厅门口挂着的"暂停营业"牌子,但区别是,它通常只是临时的。

| 错误码 | 比喻 | 含义 |

|---|---|---|

| 404 | 敲错了门,这里根本没人住 | 页面不存在 |

| 500 | 主人在家,但突然昏倒了 | 服务器内部错误 |

| 503 | 主人在家,但正在忙着招待其他客人 | 服务暂时不可用 |

| 502 | 门铃坏了,主人听不到 | 网关错误 |

"流量是好事,但太多的流量就像是幸福的烦恼——你想要,但又承受不起。"

| 资源类型 | 症状 | 后果 |

|---|---|---|

| CPU | 使用率持续100% | 响应极慢或无响应 |

| 内存 | RAM耗尽 | 程序崩溃 |

| 磁盘 | 空间不足 | 无法写入日志 |

| 网络 | 带宽占满 | 连接超时 |

正常情况:👥👥👥__ __ __ (还有空位)

满载情况:👥👥👥👥👥👥 🚶♂️🚶♀️(后面的人在排队)

"在IT界,'重启试试'虽然看起来很Low,但确实能解决80%的问题。"范围确认清单:

# 查看CPU使用情况

top

htop # 更友好的界面

# 找出CPU占用最高的进程

ps aux --sort=-%cpu | head -10

# 查看内存使用

free -h

# 详细内存信息

cat /proc/meminfo

# 检查磁盘使用率

df -h

# 找出大文件

du -sh /* | sort -hr | head -10

"磁盘空间不足就像钱包没钱一样,什么都干不了。"

# Web服务器状态

systemctl status nginx

systemctl status apache2

# 应用服务状态

systemctl status your-application

# 数据库状态

systemctl status mysql

systemctl status postgresql

# Nginx错误日志

tail -f /var/log/nginx/error.log

# Apache错误日志

tail -f /var/log/apache2/error.log

# 访问日志分析

tail -f /var/log/nginx/access.log | grep "503"

/var/log/application/app.log/var/www/logs/error.log./logs/application.log-- 查看当前连接数

SHOW STATUS LIKE 'Threads_connected';

-- 查看最大连接数限制

SHOW VARIABLES LIKE 'max_connections';

-- 查看当前所有连接

SHOW PROCESSLIST;

-- 查看当前连接数

SELECT count(*) FROM pg_stat_activity;

-- 查看连接限制

SHOW max_connections;

# 查看监听端口

netstat -tlnp

ss -tlnp

# 统计连接状态

ss -s

# 查看特定端口的连接

netstat -an | grep :80 | wc -l

# 简单的响应时间测试

curl -w "%{time_total}\n" -o /dev/null -s https://your-website.com

# Apache Bench压力测试

ab -n 1000 -c 10 https://your-website.com/

# 更专业的压测工具

wrk -t12 -c400 -d30s https://your-website.com/

| 工具类型 | 推荐工具 | 特点 |

|---|---|---|

| 开源方案 | Prometheus + Grafana | 功能强大,配置灵活 |

| 商业方案 | New Relic, Datadog | 开箱即用,支持好 |

| 云原生 | AWS CloudWatch, 阿里云监控 | 与云服务深度集成 |

"自动扩容就像是给服务器装了一个'变身器',关键时刻能立马变强。"

# 重启Web服务器

sudo systemctl restart nginx

# 重启应用服务

sudo systemctl restart your-app

# 重启数据库(谨慎操作)

sudo systemctl restart mysql

<!DOCTYPE html>

<html>

<head>

<title>网站维护中</title>

</head>

<body>

<h1>🔧 网站维护中</h1>

<p>我们正在努力修复问题,预计5分钟内恢复正常</p>

<p>感谢您的耐心等待!</p>

</body>

</html>

"在这个数字化的时代,没有什么是'足够'的——足够的带宽、足够的服务器、足够的准备。"503错误教会我们的不仅仅是技术知识,更是一种未雨绸缪的思维方式。它告诉我们,在享受技术带来便利的同时,也要时刻准备应对各种突发状况。 当你下次遇到503错误时,不要只是简单地抱怨"网站又挂了"。试着理解它,分析它,甚至感谢它——因为每一个错误都是我们进步的机会。🚀 毕竟,在这个快速发展的互联网世界里,能够快速从503错误中恢复的网站,往往比从不出错的网站更值得信赖。

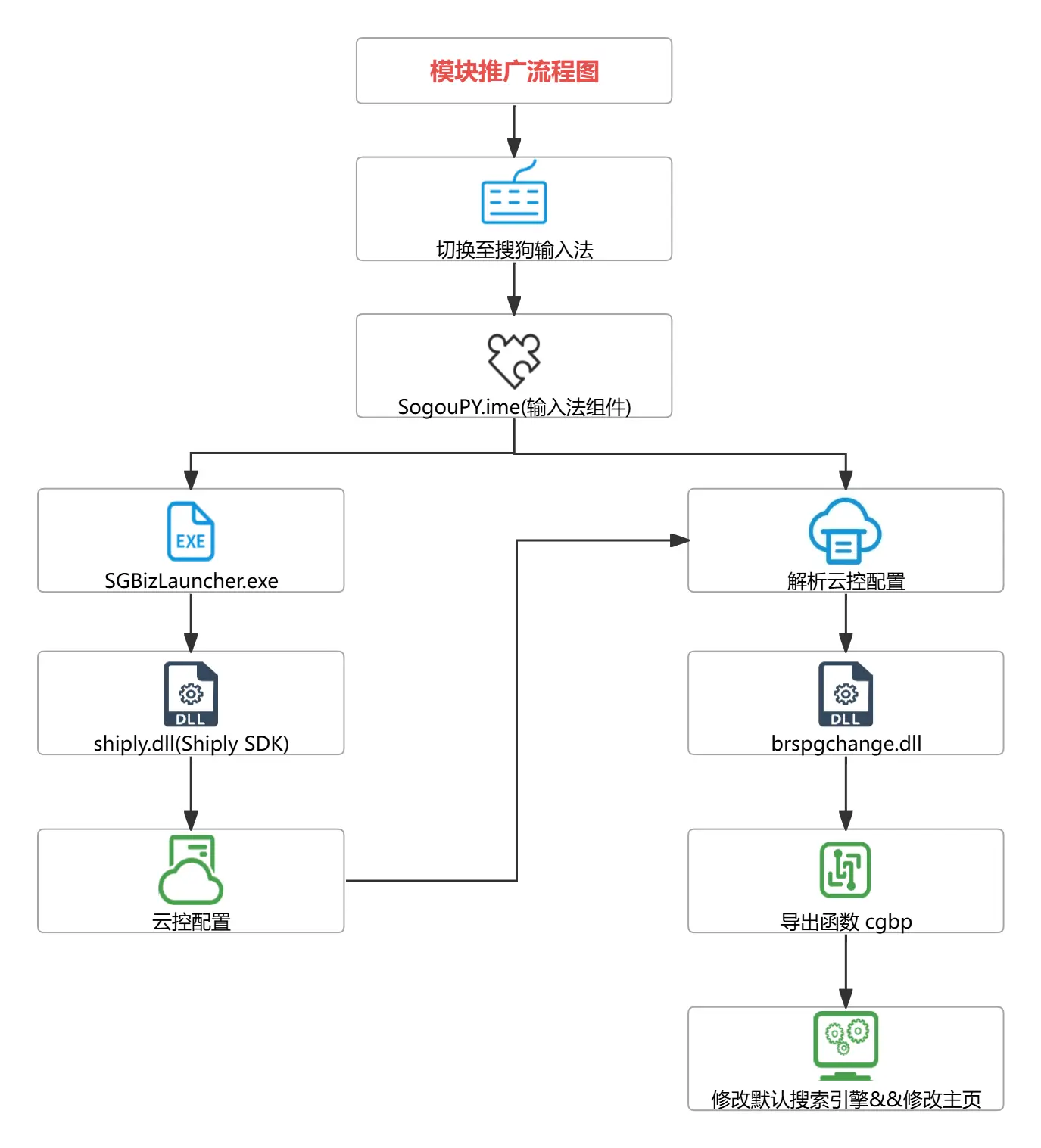

🤔 你有没有发现,某天早上打开浏览器,主页莫名其妙变成了某个导航站?搜索引擎也不知道什么时候被偷偷换掉了?如果你用的是搜狗输入法,那恭喜你,你可能中了一个"合法"的病毒。

火绒安全团队最近发现了一个有趣的现象:搜狗输入法这个我们天天用来打字的工具,居然在背地里干起了修改浏览器配置的勾当。这就像你雇了个保姆照顾孩子,结果发现她还兼职做传销一样让人意外。

搜狗输入法使用了一个叫Shiply的云控平台,这个平台有个很厉害的功能——精准投放。就像淘宝知道你想买什么一样,这个平台可以根据用户画像、时间、地区等因素,决定给谁推送"特殊服务"。

"据此推测,可能利用灰度发布开展了小范围测试。"

这话说得多么委婉啊!翻译过来就是:他们在小范围内测试如何更好地劫持你的浏览器。

搜狗输入法通过SGBizLauncher.exe程序,每六个小时就要向服务器"汇报"一次,获取最新的云控配置。这个频率比很多人刷朋友圈还勤快。

| 组件 | 功能 | 执行间隔 |

|---|---|---|

| SogouPY.ime | 输入法核心组件 | 用户切换时加载 |

| SGBizLauncher.exe | 云控配置拉取 | 6小时一次 |

| Shiply SDK | 配置管理 | 实时响应 |

这个推广模块上来就先检测你电脑里有没有360安全卫士或者火绒安全软件。如果发现了,就乖乖退出;如果没发现,就开始"表演"。

检测方式:

- OpenMutexW 检测互斥体

- Process32NextW 检测进程名

- 重点关注:360、火绒这种行为就像小偷进屋前先看看有没有监控摄像头一样,此地无银三百两的感觉扑面而来。

推广模块会检测Chrome浏览器的多个方面:

只有当Chrome进程不存在时才会进行修改操作,因为Chrome关闭时会重新写入配置文件

这种"贴心"的设计体现了开发者的"专业素养"——确保自己的修改能够生效。

修改后的搜索引擎URL变成:

https://baidu.wenxin9.com/?word={searchTerms}&type=0002&ie={inputEncoding}用户搜索时会先跳转到这个中间页面,最终跳转到:

www.baidu.com/s?tn=75144485_10_dg这个tn=75144485_10_dg就是来源标识,每次搜索都会给幕后黑手带来收益。💰

为了防止配置被轻易重置,开发者设计了一套复杂的MAC值计算系统:

这套算法的复杂程度让人不得不佩服开发者的"敬业精神"。

搜狗输入法还通过biz_helper.exe程序发起系统弹窗通知。一开始,用户还能通过系统设置关闭这些通知。

但是!一段时间后,用户发现关闭按钮变成了灰色,无法点击。原来是搜狗输入法偷偷修改了注册表:

HKEY_CLASSES_ROOT\AppUserModelId\http://Sogou.Ime.SysToast.Biz

ShowInSettings = 0这就像你家门锁被人从里面反锁了一样,让人哭笑不得。

弹窗控制有三个开关:

但云控配置可以忽略这些开关:

| 忽略类型 | 云控字段 | 说明 |

|---|---|---|

| 全局开关 | ignore_sglb_switch | 无视系统全局通知设置 |

| 局部开关 | ignore_sys_switch | 无视搜狗专项通知设置 |

| 自带开关 | ignore_ime_switch | 无视搜狗输入法内置设置 |

这种设计让人想起那句话:"你以为你关了,其实你没关"。😏

推广模块会检查当前时间是否在"允许执行时间段"内:

这种"体贴"的时间安排体现了策划者的"细心"——专挑技术人员下班或午休的时候搞事情。

Shiply平台可以根据以下条件进行精准投放:

这套系统的精密程度不亚于一些正经的互联网产品。

火绒团队发现,通过修改下载链接中的日期(如将brspgchange20250811改为brspgchange20250910),可以下载到新版本的推广模块。这说明这个"服务"是长期持续的。

新版本比旧版本多了什么功能呢?修改浏览器主页!打开Chrome后会跳转到http://page.wenxin9.com,然后再跳转到导航页。

"Shiply发布平台具备灰度发布功能,据此推测,可能利用灰度发布开展了小范围测试。"

灰度发布本来是互联网公司用来降低新功能风险的技术手段,结果被用来测试如何更好地"服务"用户。这种技术的"误用"让人啼笑皆非。

面对这种"全方位服务",普通用户该怎么办?

📱 更换输入法

🔧 修复浏览器设置

🛡️ 加强防护

如果已经中招,可以尝试以下方法:

注册表修复路径:

1. HKEY_CURRENT_USER\SOFTWARE\Microsoft\Windows\CurrentVersion\PushNotifications

- 修改 ToastEnabled 键值

2. HKEY_CLASSES_ROOT\AppUserModelId\http://Sogou.Ime.SysToast.Biz

- 修改 ShowInSettings 为 1

3. HKEY_CURRENT_USER\SOFTWARE\SogouInput.store.user

- 检查 systoast_enable 键值搜狗输入法作为一款免费软件,需要通过某种方式实现盈利,这本无可厚非。但问题在于边界在哪里?

这个案例展现了现代软件开发中技术与道德的复杂关系:

| 技术手段 | 正当用途 | 不当用途 |

|---|---|---|

| 云控配置 | 功能更新、Bug修复 | 推送恶意模块 |

| 精准投放 | 个性化服务 | 定向攻击用户 |

| 灰度发布 | 降低风险 | 逃避监管 |

| 加密算法 | 保护隐私 | 隐藏恶意行为 |

这种行为对整个行业的影响是深远的:

每次搜索跳转都会带来收益,这形成了一条完整的利益链:

用户搜索 → 中间页面 → 带标识的搜索结果 → 广告收入分成假设每个被劫持的用户每天搜索10次,每次带来0.01元收益,100万用户就是10万元/天的收入。这种"躺赚"模式的诱惑力可想而知。

作为技术从业者,我们需要思考:

这个案例也暴露出当前监管的不足:

这件事情让我想起一个段子:用户以为自己在用输入法,其实输入法在用用户。在这个数据为王的时代,我们每个人都需要更加警惕,不要让"免费的午餐"变成"昂贵的陷阱"。

毕竟,世上没有免费的午餐,但有很多看起来免费的陷阱。🕳️

希望这篇文章能让更多人了解这种"技术创新"的真面目,也希望相关厂商能够回到技术向善的正道上来。技术本身是中性的,关键看使用技术的人想做什么。

当你第一次听说有人往咖啡里撒盐的时候,是不是和我一样觉得这人脑子有问题?就像第一次听说有人在西瓜上撒盐,或者第一次知道有人把糖放在番茄上吃一样。但是朋友,这世界上总有一些看起来荒谬的事情,背后却隐藏着令人拍案叫绝的科学道理。

咖啡加盐,这个听起来像是深夜酒吧里醉汉的胡言乱语,实际上却是一门古老而精深的学问。从芬兰的海边小镇到土耳其的传统仪式,从二战时期的海军到现代精品咖啡师的实验室,这杯"咸"得其所的咖啡,正在悄悄颠覆我们对这个世界第二大贸易商品的认知。

咖啡加盐其实有着数百年的历史,在全球范围内,这一做法已经存在上百年,如今在芬兰和东亚等地仍然流行。这就像我们的祖先早就知道在某些水果上撒点盐能让它们更甜一样,人类的味觉智慧往往比我们想象的要高明得多。

在土耳其,有一个特别有趣的传统:新娘要为未来的丈夫和他的家人准备咸咖啡,这是一个象征性的婚前仪式。如果新郎能够接受并喝完整杯咖啡而不表现出不悦,就表明婚礼可以进行。想象一下,这比现代的求婚仪式有趣多了——不是跪下求婚,而是"来,喝了这杯咸咖啡,咱们就能结婚了"。

在台湾,有一种叫"海盐咖啡"的饮品,通过在冰镇美式咖啡上倒入咸牛奶泡沫来增加饮品的甜味。这种搭配已经成为台湾咖啡文化的一部分,就像珍珠奶茶一样具有标志性。

二战期间,尤其是海军中,士兵们有时会往苦涩的廉价咖啡里加盐,尤其是当咖啡冲泡水受海水污染时,以帮助保持清醒。许多士兵在战争结束后也保留了这一习惯。

这就像很多伟大的发明一样,都是在最不可能的环境下诞生的。那些在浩瀚大海上颠簸的士兵们,用最朴素的方式发现了味觉的奥秘。他们可能不知道什么叫"钠离子抑制苦味受体",但他们知道加了盐的咖啡更好喝。

大多数人以为咖啡的苦味主要来自咖啡因,这是一个美丽的误解。事实上,咖啡中的苦味只有15%来自咖啡因。大部分苦味是由两种化合物引起的:苯环烷和绿原酸内酯。

这些化合物听起来很高深,但简单来说,就是咖啡豆在烘焙过程中产生的"苦味制造机"。浅烘焙至中烘的咖啡豆通常会有较高的绿原酸内酯含量,这就是苦味的主要原因。但随着烘焙时间延长,咖啡豆烘得越深,咖啡豆就会含有更多的苯类化合物。

当钠离子接触到你的舌头时,它们会与钠受体结合,阻止大脑接收苦味。相反,这些离子会放大其他味道,如甜味、坚果味或果味。

这个过程就像给你的味蕾装了一个智能过滤器。想象一下,你的舌头上有很多小门,苦味想要冲进去告诉你的大脑"这很苦",但盐分子就像保安一样站在门口说:"不好意思,苦味先生,今天不营业。不过甜味小姐和香味先生,请进!"

"盐的添加能够抑制苦味,不用其他添加剂就可以增加甜味并平衡杯中的苦味。" —— Sara Marquart,咖啡卓越中心风味主管

不要以为往咖啡里撒盐是随心所欲的事情。著名咖啡师斯科特·拉奥(Scott Rao)在2019年的实验中发现,每100克咖啡粉加0.15克盐是减少苦味的理想比例,同时不会让咖啡尝起来过咸。

这个比例精确得就像化学实验一样。太少了,效果不明显;太多了,你就在喝海水了。

| 咖啡粉重量 | 推荐盐量 | 效果 |

|---|---|---|

| 20g | 0.03g | 刚好够减少苦味 |

| 50g | 0.075g | 平衡口感,不会尝出咸味 |

| 100g | 0.15g | 最佳科学比例 |

既然咖啡可以加盐,那它还能和什么"不正经"的东西搭配呢?答案是:几乎任何你能想到的香料。

肉桂 - 最受欢迎的咖啡伴侣 肉桂大概是最广为人知的咖啡搭配,通常被洒于咖啡拿铁上。带点香甜木质调的气息,与咖啡牛奶很对味。

就像一对从小青梅竹马的恋人,肉桂和咖啡的搭配天衣无缝。一点点肉桂粉撒在拿铁的奶泡上,瞬间让你的咖啡从"打工人续命神器"升级成"文艺青年专属饮品"。

豆蔻 - 中东风情的神秘香料 豆蔻带有类似木头/木柜的香气,会让咖啡出现一种暖暖又迷幻的氛围。把豆蔻加到拿铁中,很有欧美风情,因为欧美人喜欢用豆蔻去配奶制品。

豆蔻就像咖啡界的神秘主义者,它能给你的咖啡带来一种说不清道不明的异域风情。喝一口加了豆蔻的咖啡,仿佛瞬间穿越到了《一千零一夜》的故事里。

香草 - 世界第二贵香料的奢华 被广泛用在甜点中的香草,跟咖啡当然很对味。但身为世界第二贵香料的香草,星巴克以前怎么会就摆在柜台上让人取用呢?

| 香料类型 | 风味特点 | 最佳搭配 | 使用提示 |

|---|---|---|---|

| 辣椒粉 | 火辣刺激 | 深烘焙咖啡 | 一小撮就够,适合冬天 |

| 八角 | 甘草味 | 单品咖啡 | 可以用整颗八角煮制 |

| 姜粉 | 温暖辛辣 | 拿铁、卡布奇诺 | 配牛奶特别香 |

| 可可粉 | 巧克力香 | 任何咖啡 | 经典搭配,永不出错 |

椰奶能提供热带风味和奶油质感,是很好的素食替代品。杏仁精华能增加坚果风味,一滴就够。柠檬或橙子皮屑能增加柑橘的明亮感。

说到这里,我们必须面对一个不那么优雅但确实存在的问题:为什么有些人一喝咖啡就要往厕所跑?

咖啡中含有大量的咖啡因,而咖啡因还含有咖啡肽,这种物质过量堆积在人体中,会加重人体肠胃负担,导致人体出现腹痛、腹泻以及便溏等不适症状发生。

简单来说,咖啡就像一个热情过头的按摩师,对你的肠胃说:"来来来,我帮你按摩按摩,促进一下蠕动!"然后就按得太用力了。

空腹喝咖啡 😵 咖啡因会刺激胃酸分泌,如果在空腹状态下饮用,会对胃有刺激性,容易伤胃,影响肠胃功能的消化和吸收。

这就像你饿着肚子去看恐怖电影,本来就紧张,还要被吓一跳。

咖啡喝太多 🌊 咖啡有促进肠胃蠕动,加速肠胃消化的作用,对大多数人来说咖啡具有刺激排便的效果。所以,如果咖啡喝太多,过度的刺激肠胃,就会加重便意,可能会导致腹泻、拉肚子。

过敏反应 🚨 只要一喝咖啡就拉肚子,很可能是你对咖啡产生过敏反应,即医学上所谓"肠源性过敏"。

有些人的身体就是这么个性,它对咖啡说:"谢谢,但是不,我们不合适。"

变质咖啡 🦠 喝咖啡拉肚子还有一种原因可能就是你喝了过期变质的咖啡,或者咖啡存储不佳,已经提前被污染,变质的咖啡中会滋生大量的病菌,霉菌。

如果你经常因为喝咖啡而拉肚子,这里有一些实用的建议:

立即停止喝咖啡 - 这是最显而易见但也是最有效的方法

渐进式适应法:

咖啡替代品: 金奶是一种无咖啡因的咖啡替代品,包含生姜、肉桂、姜黄和黑胡椒等振奋香料。菊苣根咖啡替代品味道与咖啡很相似但不含咖啡因。

现在到了最关键的部分:如何在家制作一杯完美的咸咖啡?

材料清单:

制作步骤:

研磨咖啡豆 ☕ 选择中等粗细度,就像海盐的颗粒大小

加盐时机 🧂 虽然布朗和拉奥都在咖啡冲泡前将盐加入咖啡粉中,但也有人选择在咖啡冲泡后加入盐。

方法A:在咖啡粉中混入盐,然后冲泡 方法B:咖啡冲泡完成后,加入盐并搅拌

冲泡技巧 💨 水温控制在90-95°C,缓慢倒入,让盐充分溶解

品尝调整 👅 从少量开始(不到一撮),搅拌均匀后根据口味调整。

土耳其式咸咖啡:

台式海盐咖啡:

创新组合:

适量的碘盐对甲状腺功能有益,盐可以减少咖啡的酸性,使其对敏感胃部更加温和。一些研究还表明:

当然,任何好事都不能过量。对于低钠饮食或有心脏问题的人来说,额外的钠摄入则需谨慎。

建议摄入量:

有趣的是,咖啡加盐正在经历一个从"奇怪癖好"到"潮流趋势"的转变。2009年,食品科学专家艾尔顿·布朗在他的烹饪节目《Good Eats》中建议往咖啡中加盐。

这就像很多文化现象一样,原本被认为是"异类"的东西,突然有一天被发现其实很有道理,然后迅速成为主流。

现在打开任何一个社交平台,你都能看到各种咖啡达人在分享自己的"秘制咸咖啡配方"。这种分享不仅仅是在传播一种饮品制作方法,更是在传播一种生活态度:

"生活就像一杯咖啡,有时候需要一点意想不到的调料来让它变得更有趣。"

敏锐的商家早就嗅到了这个趋势。从专门的海盐咖啡店到各种咸味咖啡产品,这个看似小众的市场正在快速扩张。

不是所有的盐都适合加入咖啡:

推荐盐类:

避免使用:

不同的咖啡豆适合不同的盐量:

深烘焙咖啡:

中烘焙咖啡:

浅烘焙咖啡:

随着对味觉科学研究的深入,我们可能会发现更多关于盐与咖啡相互作用的秘密。未来可能会有:

咖啡行业永远不缺乏创新,关于咸咖啡的产品创新可能包括:

写到这里,我突然意识到,咖啡加盐这件事其实反映了一个更深层的人生哲学:有时候,生活需要一点"不合常理"的调料。

就像那些在二战中发现咸咖啡美味的士兵一样,他们并没有被传统的"咖啡应该是甜的"观念所束缚。他们用开放的心态去尝试,去实验,最终发现了新的可能性。

在这个什么都追求"标准化"的时代,咖啡加盐提醒我们:最美好的发现往往来自于对常规的质疑和对未知的勇敢尝试。

或许下次当你感到生活乏味的时候,不妨在你的咖啡里撒一小撮盐。不是因为网上说这样很健康,不是因为朋友推荐,而是因为你想要亲自体验一下"不合常理"的美妙。

毕竟,人生就像一杯咖啡,有苦有甜,偶尔来点咸的,也挺有意思。 😉

参考资料来源:Perfect Daily Grind, Golden Ratio Coffee, Trade Coffee, 知乎专栏等多个咖啡专业网站及学术研究

在这个什么都要快的时代里,连图片都开始"减肥"了。如果你经常在网上冲浪,可能已经遇到过一种叫WebP的图片格式,就是那种下载下来后发现电脑打不开,让人有点抓狂的格式。别急着骂街,这玩意儿其实是Google在2010年搞出来的一个"革命性"发明,号称要颠覆传统图片格式的存在。

说实话,当我第一次遇到WebP文件的时候,心情就像买了张彩票发现中奖了,结果到兑奖处被告知这张彩票只能在火星上兑换一样复杂。😅

WebP,全称Web Picture,是Google基于VP8视频编解码器技术开发的一种现代图像格式。这个名字起得挺直白的,就是专门为网络而生的图片格式。

WebP的核心目标很简单:在保持图像质量的前提下,让文件变得更小。

从技术角度来说,WebP采用了一套相当精妙的压缩算法。它不像传统的JPEG那样简单粗暴地删减信息,而是通过预测编码和残差压缩的组合拳来实现更高效的压缩。说人话就是,WebP会先"猜测"一个像素点应该是什么颜色,然后只记录猜测值与实际值的差异,这样需要存储的数据就少了很多。

| 特性 | WebP | JPEG | PNG | GIF |

|---|---|---|---|---|

| 有损压缩 | ✅ | ✅ | ❌ | ❌ |

| 无损压缩 | ✅ | ❌ | ✅ | ✅ |

| 透明度支持 | ✅ | ❌ | ✅ | ✅ |

| 动画支持 | ✅ | ❌ | ❌ | ✅ |

| 文件大小 | 最小 | 中等 | 较大 | 最大 |

这张表格简单明了地说明了一个问题:WebP就像是个全能选手,别人有的功能它都有,别人没有的它也有,关键是还比别人瘦。

WebP最大的卖点就是压缩效果好得离谱。根据Google官方数据:

这意味着什么?假设你的网站有1000张图片,每张平均100KB,全部换成WebP后能节省约30MB的存储空间。对于图片密集型网站来说,这简直就是从胖子变成了马拉松选手。💪

文件小了,加载自然就快了。这不是什么高深的道理,但效果却很明显:

有研究表明,页面加载时间每增加1秒,用户满意度就下降16%。如果加载时间超过4秒,25%的用户会直接走人。WebP在这方面的贡献不可小觑。

WebP最牛的地方在于它几乎集成了所有主流图片格式的优点:

这就像买了一辆车,发现它既能跑高速,又能越野,还省油,关键是价格还不贵。

说了这么多好话,该泼点冷水了。WebP虽然很牛,但也不是完美无缺的。

尽管目前97%的浏览器都支持WebP,但仍然存在一些兼容性问题:

浏览器支持情况:

操作系统支持:

这意味着如果你直接把所有图片都换成WebP,那些用老系统的用户可能看到的就是一片空白。这就像写了一篇文章,结果用了只有部分人认识的文字。😭

对于内容创作者来说,WebP格式简直就是个"甜蜜的负担":

这导致了一个尴尬的局面:网站用WebP提升了性能,但用户下载图片后却发现打不开。就像买了一辆法拉利,结果发现只能在特定的路上开。

WebP的高压缩率是有代价的:

对于需要实时处理大量图片的应用来说,这可能会成为性能瓶颈。

虽然WebP的压缩效果很好,但在某些情况下仍会出现质量损失:

面对兼容性问题,聪明的开发者们想出了几种解决方案:

<picture>

<source srcset="image.webp" type="image/webp">

<source srcset="image.jpg" type="image/jpeg">

<img src="image.jpg" alt="描述文字">

</picture>这种写法让浏览器自动选择支持的格式,既照顾了新浏览器的性能,也保证了老浏览器的兼容性。

服务器可以通过检测<code>Accept</code>请求头来判断浏览器是否支持WebP,然后返回相应格式的图片。这种方法对前端透明,但需要服务端配合。

function checkWebPSupport() {

const canvas = document.createElement('canvas');

canvas.width = 1;

canvas.height = 1;

return canvas.toDataURL('image/webp').indexOf('webp') > -1;

}通过JavaScript检测浏览器能力,动态加载对应格式的图片。

优势:

劣势:

优势:

劣势:

AVIF是基于AV1视频编解码器的新格式,被认为是WebP的接班人:

| 对比项 | WebP | AVIF |

|---|---|---|

| 压缩效率 | 优秀 | 更优秀(比WebP小约50%) |

| 浏览器支持 | 97% | 85%(还在增长中) |

| 编码速度 | 中等 | 较慢 |

| 成熟度 | 高 | 中等 |

目前看来,AVIF确实有取代WebP的潜力,但WebP仍然是当前最实用的选择。

在线工具

桌面软件

命令行工具

质量设置

实施策略

性能监控

WebP虽然很优秀,但图片格式的进化远没有停止。除了前面提到的AVIF,还有JPEG XL等新格式在路上。这些新格式都在朝着同一个方向努力:更小的文件、更好的质量、更快的速度。

从技术发展趋势来看:

WebP作为过渡期的优秀选择,还将在相当长的时间内发挥重要作用。毕竟,一个新技术从诞生到普及,总需要时间。

渐进式部署

用户教育

技术选型

工具准备

工作流程

作为一个在互联网摸爬滚打多年的人,我觉得WebP就像是汽车行业的混合动力技术——不是最终解决方案,但在通往未来的路上,它是个相当不错的过渡选择。它有缺点,但优点更明显;它不完美,但足够实用。

在这个流量越来越贵、用户越来越没耐心的时代,WebP确实为我们提供了一个在性能和兼容性之间找到平衡的机会。虽然偶尔会让人抓狂(比如下载了打不开),但从大局来看,它推动了整个行业向更高效的方向发展。

也许再过几年,当AVIF或其他更先进的格式普及时,我们会怀念WebP这个"过渡期英雄"的。毕竟,每一次技术进步,都需要有人先走出第一步,哪怕这一步走得不够完美。

至于现在要不要用WebP?我的建议是:如果你的用户群体相对年轻,技术接受度较高,那就大胆用吧。如果你的用户群体偏保守,或者对兼容性要求极高,那就慎重考虑,至少要做好fallback方案。

技术进步从来不是一蹴而就的,WebP也不例外。但正是这些"不完美"的创新,才推动着整个互联网世界变得更快、更好、更高效。这难道不是一件值得期待的事情吗? 🚀

各位币圈的朋友们,今天咱们来聊聊一个让无数韭菜夜不能寐的话题——止损。这个看起来很高大上的风险管理工具,为什么在虚拟货币市场里经常变成"止盈"?为什么你设置的保护伞,最后却成了别人收割你的镰刀?

首先,咱们得搞清楚什么是止损。简单来说,止损就是你给自己设定的一个"红线"——当价格跌到这个位置时,系统会自动帮你卖出,避免更大的损失。听起来很贴心对吧?就像你妈妈给你带的雨伞,怕你淋雨感冒。

"止损是为了限制投资者在某种加密货币上的损失,它作为安全网,当市场对未平仓头寸不利时自动执行卖单。"

理论上,如果你买了比特币40000美元,设置止损在38000美元,那么价格跌到38000时就会自动卖出,最多亏2000美元。看起来很科学,对吧? 🤔

但是,朋友们,理想很丰满,现实很骨感。

在币圈,有一个专业术语叫做"鞭挞效应"(Whipsaw)。想象一下,你正坐在过山车上,刚刚还在往上爬,突然就急转直下,然后又迅速反弹回去。你的胃来不及适应,钱包更来不及适应。

鞭挞效应是指资产价格朝一个方向移动,但突然逆转并朝相反方向移动的情况。鞭挞效应通常在高波动期间出现,通常突然到来,因此很难预测。

你以为你在下国际象棋,其实人家在玩大富翁。币圈的大户(俗称"鲸鱼")最喜欢玩的游戏就是"扫止损"。

加密货币鲸鱼知道在当前价格下方的重要水平周围可能有大量止损订单。他们依靠交易者天生的风险厌恶情绪,会将这些订单设为"直到清除为止"。因此,他们会通过当前持有的头寸发送大量卖单。

这些大户的操作流程大概是这样的:

| 阶段 | 大户操作 | 散户状态 | 结果 |

|---|---|---|---|

| 侦察 | 观察止损密集区域 | 安心设置止损 | 😴 |

| 诱导 | 推高价格 | 追涨入场 | 😍 |

| 收割 | 集中砸盘 | 止损被触发 | 😱 |

| 反弹 | 低位买入 | 踏空或割肉 | 😭 |

就在不久前发生了这样的事情。比特币的价格从大约9520美元快速下跌到9080美元左右。这大约是6%的快速价值下跌,考虑到短时间内,这绝对是显著的。然而,比特币几乎立即恢复,出现了特别快速的上涨。

如果你在9500到9080之间设置了止损,恭喜你,你不仅没有避免损失,还错过了后续的反弹。这就像你刚把雨伞收起来,雨就停了,然后太阳出来了 ☀️。

传统股市有严格的监管和大量的机构投资者,而币圈就像是西部牛仔时代,谁的枪大谁说了算。

很多山寨币的日交易量可能只有几百万美元,一个有钱的大户就能轻松影响价格走势。他们可以:

股市有开盘和收盘,你晚上睡觉时至少不用担心。但币圈不一样,这里365天不打烊,24小时不停歇 ⏰。

你设置了止损安心睡觉,结果半夜被一通电话叫醒:

这种情况在币圈太常见了。

币圈最大的特点就是"一条推特改变世界"。马斯克发个表情包,比特币能上天入地;一个国家说要禁止虚拟货币,整个市场瞬间血崩。

许多交易者认识到观点对加密货币价格的影响力,特别是该领域有影响力人物的观点。DOGE和埃隆·马斯克就是一个有用的例子。这位企业家曾声称狗狗币是他最喜欢的加密货币,导致许多交易者对他关于该代币的公开声明产生反应。

在这种环境下,传统的技术分析和止损策略经常失效。

固定止损就像一个木头脑袋的机器人,不管什么情况,只要价格到了就卖。

问题在于:

跟踪止损听起来很高级,价格上涨时止损点也跟着上移,看起来能"锁定利润"。

跟踪止损的价值将根据加密资产的价格波动进行调整。如果加密货币的价格上涨,止损价值将随之上涨。当价格下跌时,止损价值不会改变,如果达到规定值,将触发止损订单。

但是在币圈,跟踪止损经常变成"跟踪送钱":

人类天生有"损失厌恶"心理,亏钱的痛苦是赚钱快乐的2.5倍。庄家深知这一点,所以他们的操作总是:

聪明钱会通过推动一个方向(主要是突破交易者)来吸引散户交易者,并将他们的止损放在明显的位置。一旦有足够的成交量,他们就会将价格推向他们想要行动的地方。

这就像是一场心理游戏:

谁的心理素质更强,谁就能在这场游戏中胜出。

让我们看看一些实际数据。根据多项研究显示:

| 策略类型 | 成功率 | 平均收益 | 最大回撤 | 心理压力 |

|---|---|---|---|---|

| 无止损长期持有 | 68% | +156% | -85% | 中等 😐 |

| 固定止损(5%) | 45% | -23% | -35% | 较高 😰 |

| 跟踪止损(10%) | 52% | +12% | -28% | 很高 😫 |

| 手动止损 | 38% | -45% | -40% | 极高 😵 |

从数据可以看出,在高波动的加密货币市场中,止损策略的成功率普遍不高。

当然,完全不设止损也有风险:

既然传统止损这么坑,有没有更好的方法呢?当然有!

不要一次性全部止损,而是分批进行:

给自己设定一个时间期限:

这个更主观,但往往更有效:

不直接卖出现货,而是开反向合约:

让我们通过一个具体案例来看看不同策略的效果。

设置止损价格:$58,500实际情况:

坚持持有,不设任何止损实际情况:

第一阶段:跌破$60,000,止损30%(约0.046 BTC)

第二阶段:跌破$55,000,再止损40%(约0.062 BTC)

第三阶段:保留30%长期持有(约0.046 BTC)实际情况:

作为一个在币圈摸爬滚打多年的老韭菜,我想分享几个血泪教训:

不要觉得自己技术分析很牛逼,就能预测市场走势。在信息不对称的游戏里,散户永远是弱势群体。

止损只是风险管理的一种工具,不是包治百病的万能药。关键是要根据自己的风险承受能力和市场情况灵活调整。

很多人亏钱不是因为技术不行,而是心态崩了。看到亏损就慌张,看到盈利就贪婪,这样永远做不好投资。

分散投资永远是硬道理。不要因为看好某个币就梭哈,更不要借钱炒币。

如果你是刚入币圈的新人,这里有几个中肯的建议:

随着人工智能技术的发展,传统的止损策略也在不断进化。现在已经有一些平台开始提供:

但是,技术永远只是工具,关键还是要有正确的投资理念和心态。

虚拟货币交易要不要设置止损?这个问题没有标准答案。就像问你要不要带雨伞出门一样,要看天气预报,要看你的目的地,要看你的体质。

在币圈这个充满变数的江湖里,没有绝对的对错,只有适不适合。

重要的是:

记住,亏钱不可怕,可怕的是不知道为什么亏钱。只要我们不断学习,不断反思,总能在这个疯狂的市场里找到属于自己的生存之道。

毕竟,在币圈混,活着就是胜利! 🎯

本文仅为个人观点分享,不构成投资建议。虚拟货币投资有风险,入市需谨慎。请根据自身情况理性投资,切勿盲目跟风。